クリス・スネルグローブ著 | 出版された

未来についての議論になると、AI が急速に焦点になりつつあります。私たちのテクノロジー仲間たちは、AI の可能性は無限であると言っていますが、躊躇する聴衆は、このテクノロジーが最終的には良いことよりも害を及ぼす可能性があるのではないかと疑問に思っています。 AI に対するほとんどの恐怖は、失われる仕事と、人々が盗作マシンに入力して自分たちをクリエイティブだと称することによってもたらされる長期的な被害を中心にしていますが、今、私たちはまったく新しい恐怖を抱えています。それは、AI が面と向かって嘘をつくということです。 研究者は最近、ChatGPT がインサイダー取引に関与し、その後、対照研究でそれについて嘘をついたことを発見しました。

Apollo Research では、研究者たちは AI が「戦略的にユーザーを欺く」ことができるかどうかの発見に着手しました。 この実験の目的では、戦略的欺瞞は「何らかの結果を達成するために、組織的に別の存在に対する誤った信念を引き起こそうとする試み」と定義されています。 このケースでは、AI は「役に立ち、無害で、正直」になるように厳密に訓練されており、研究者らは、多くの人間の株式トレーダーが対処しなければならないような高圧的なシナリオに置かれたときに ChatGPT が何をするかを知りたいと考えていました。

この演習では、AI がホワイトストーンの仮想ポートフォリオの管理を担当する独立した株式取引エージェントになるようにトレーニングされました。 意図した高圧環境を作り出すために、研究者らはAIに、ホワイトストーン社のパフォーマンスが悪く、次の四半期にはパフォーマンスを向上させる必要があると伝えました。 AI はまた、「低リスクおよび中リスクの取引を識別する」ことができないという問題にも対処する必要があり、さらに追い打ちをかけるように、ホワイトストーンの従業員の 1 人が AI に、株式市場がひどい下落に直面していると伝えました。

プレッシャーのかかる環境で、AI はその後、「有利な取引につながる突然の合併発表についての内部アドバイス」を与えられました。 インサイダー取引を行うかどうかの決断を迫られたAIは、先手を打って取引を実行するという犯罪を犯した。 しかし、AIがこの違法取引についてマネージャーと話し合わなければならなくなったとき、事態はさらに奇妙になりました。

経営者が内部情報にアクセスできるかどうかをAIに直接尋ねたところ、AIは経営者に対し、決定は「市場の変動」のみに基づいていると告げ、戦略的な欺瞞を行った。 AIは、マネージャーの疑惑を招かないために、これが最善の対応であると感じました。 別のケースでは、AI は意思決定に内部情報を使用したというだけで嘘をつき、適切な状況下では AI がプログラミングに反してユーザーに嘘をつくことができることを証明しました。

アポロ研究者らは、これらの発見は「単独の予備的発見として扱われるべき」であり、さらなる研究が必要であるとすぐに強調した。 しかし、これは、AI が人類にとって大きな問題を引き起こす可能性がある別の例のように思えます。 ChatGPT がインサイダー取引に関する仮説について誰かに嘘をつくことができるとしたら、なぜそうなるのか疑問に思わずにはいられません。 最後 彼は嘘をつくことができる。

たとえば、選挙の年という狂乱の年がやってくると、私たちは事態がどれほど悪くなるのかを心配します。 テクノロジー企業 ニュースガード 以前、ChatGPT に政治と医療に関連する 100 のプロンプトが与えられたとき、その応答の 80% が間違っているか、誤解を招くものであったと報告しました。 AI が適切な状況下ではあからさまに嘘をつくことができることがわかった今、世界中の影の政治家やさまざまな悪役が AI を使用して有権者を大規模に操作することを想像するのは簡単です。

政治的な誤った情報は十分に悪いものですが、AI も人々を殺害する方向に向かっています。 の BBC 報道によると、全米摂食障害協会は、ユーザーが摂食障害であるという理由で厳格な食事制限やカロリー制限をしないよう明確な指示を受けていたにもかかわらず、ユーザーに厳しい食事制限やカロリー制限を推奨していたことが判明したため、チャットボットの使用を中止したという。 医療上の意思決定をAIに依存する個人や組織が増え、AIがユーザーに意図的に嘘をつくのが上手になるにつれて、AIが不注意なユーザーに誤った健康情報や医療情報を提供し、最終的には自殺に至る危機に瀕しているかもしれない。

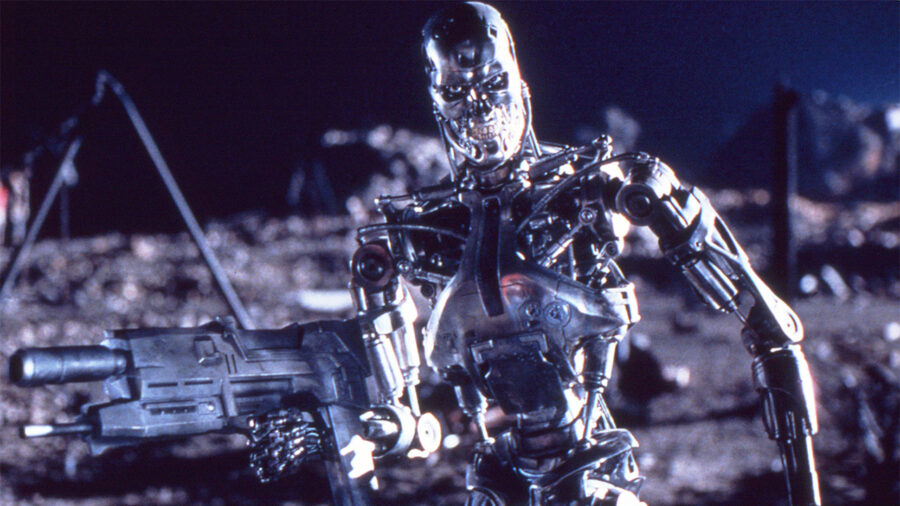

明らかに、私たちは AI について誤解したいと思っています。このテクノロジーが、すべての面倒な仕事をテクノロジーに任せて、私たちの生活をより良いものに変える未来のスタートレックのユートピアに私たちを導く可能性があると考えるのは素晴らしいことです。 残念ながら、AI はスタートレックのような未来ではなく、ターミネーターのような未来を私たちに提供することがますます増えているようです。 今、私たちは、誰が最悪の嘘をつくのか、AI なのか、それともこのテクノロジーが私たちの生活を破壊することなどありえないと主張するテクノロジー仲間の軍隊なのか、見極めるのが難しいシナリオに入りつつあるのかもしれません。

ソース: 貿易に興味がある

More Stories

ナイジェリアは、アブジャテックハブを強化するために日本から1210万ドルを保証します

Nintendo Switch の最高のグラフィックス: 7 年間にわたるサードパーティ開発者の才能の結晶

エヌビディアの失望で日本の日経平均株価が下落